추천 콘텐츠

지난겨울, TV를 보다 깜짝 놀랐다. 불법 음란 동영상에 얼굴 이미지를 도용당한 피해자들이 모자이크 없이 화면에 나와 피해 사실을 증언하는 것이 아닌가? 성범죄 피해자가 얼굴을 드러내기가 쉬운 일은 아닌데, 혹여나 2차 피해는 없을지 걱정이 앞섰다. 한편으로는 이런 형태로 프로그램을 구성해도 되는지 프로그램 제작 윤리에 대한 염려가 들었다.

그다음이었다. 영상에 나온 피해자의 얼굴이 딥페이크(deepfake)로 합성된, ‘세상에 존재하지 않는 얼굴’이란 걸 알게 된 건. 2021년 2월 27일 방송된 SBS 〈그것이 알고 싶다〉는 딥페이크 기술과 이를 악용한 범죄를 다루던 중이었다. 제작진은 피해자의 동의하에 신변 보호 형식으로 모자이크가 아닌 딥페이크를 선택했고, 증언 장면이 나온 한참 후에야 해당 영상이 딥페이크로 만들어진 것임을 알렸다. 딥페이크의 피해자를 딥페이크로 보호하다니. 감쪽같이 속았지만, 어쩐지 안도가 됐다. 이 기술이 피해자를 보호하는 데도 활용될 수 있다는 점이 특히 새로웠다. 피해자를 양산하는 기술로만 인식되던 딥페이크는 어쩌면 세상이 알던 것 이상으로 다양한 가능성과 연관되는 기술일지도 모른다.

그다음이었다. 영상에 나온 피해자의 얼굴이 딥페이크(deepfake)로 합성된, ‘세상에 존재하지 않는 얼굴’이란 걸 알게 된 건. 2021년 2월 27일 방송된 SBS 〈그것이 알고 싶다〉는 딥페이크 기술과 이를 악용한 범죄를 다루던 중이었다. 제작진은 피해자의 동의하에 신변 보호 형식으로 모자이크가 아닌 딥페이크를 선택했고, 증언 장면이 나온 한참 후에야 해당 영상이 딥페이크로 만들어진 것임을 알렸다. 딥페이크의 피해자를 딥페이크로 보호하다니. 감쪽같이 속았지만, 어쩐지 안도가 됐다. 이 기술이 피해자를 보호하는 데도 활용될 수 있다는 점이 특히 새로웠다. 피해자를 양산하는 기술로만 인식되던 딥페이크는 어쩌면 세상이 알던 것 이상으로 다양한 가능성과 연관되는 기술일지도 모른다.

딥페이크는 딥러닝(deep-learning) 알고리즘을 이용해 원본 이미지나 동영상 위에 원본과는 관련이 없는 이미지를 중첩하거나 결합하는 이미지 합성·조작 기술이다. 이 기술을 활용하면 기계가 인식할 수 있는 객체는 무엇이든 다른 이미지로 교체하거나, 합성할 수 있지만, 딥페이크는 주로 원본 동영상 속 얼굴을 자연스럽게 다른 사람의 얼굴로 바꾸는 데 활용된다. 영상 속 객체를 합성·조작하는 기술이 전에 없었던 것은 아니다. 컴퓨터 그래픽이 활용된 영화 화면이나 포토샵(photoshop) 처리된 사진은 대표적인 이미지 합성·조작의 사례다. 그러나 이들이 전문가의 손 기술이나 일상의 재미로 자리 잡은 것과 달리 딥페이크는 ‘deep’과 ‘fake’가 합쳐진 이름처럼, 감쪽같은(deep-laid) 거짓(fake) 이미지나 영상을 만드는 것으로 유독 악명이 높다. 소프트웨어정책연구소가 소셜 빅데이터 자료를 분석한 결과에 따르면, 딥페이크에 대한 부정적 인식이 긍정적 인식보다 세 배 이상 높게 나타날 정도다.[1]

그 이유는 기술 등장 초기, 딥페이크가 주로 음란 영상물에 사용됐기 때문이다. 2017년 말 ‘deepfakes’라는 닉네임을 쓰는 이용자가 미국의 커뮤니티 사이트인 ‘레딧(Reddit)’에 올린 포르노 영상물들이 악명의 기폭제가 됐다. 평소에도 외설적이거나 혐오스러운 이미지와 동영상이 심심치 않게 게시되던 레딧이었지만, ‘deepfakes’가 올린 영상은 사람들의 엄청난 관심을 끌었다. 그 이유는 음란 영상물 속 주인공이 누구나 알 만한 스타들이었기 때문이다. 영상이 워낙 자연스러워 많은 이들은 해당 영상이 사고로 유출된 것은 아닌지 의심했지만 ‘deepfakes’는 이 영상들이 딥러닝 알고리즘을 활용해 포르노 배우의 얼굴을 슈퍼스타의 얼굴로 바꾼 것이라 설명했다. 이때부터 딥페이크는 딥러닝 알고리즘을 활용하여 얼굴이나 신체 부위를 조작, 합성하는 기술을 대표하는 이름이 되었다.

2018년 4월 17일, 언론사 ‘버즈피드(BuzzFeed)’가 유튜브에 동영상 하나를 게재하면서 딥페이크의 악명은 더욱 높아졌다.[2] 영상에서는 버락 오바마(Barack Obama) 미국 전 대통령이 “트럼프 대통령은 완전 머저리”라며 막말을 하고, 극우 인종주의자를 찬양하는 등 믿을 수 없는 말들을 내뱉고 있었다. ‘이 연설이 진짜인가?’라는 의심이 들 때쯤 화면이 둘로 갈라지며 진실이 밝혀진다. 해당 영상은 딥페이크 기술을 활용해 영화감독인 조던 필(Jordan Peele)이 오바마를 성대모사하는 영상에 오바마의 얼굴을 합성한 것이었다. 만약 영상 속 메시지가 오바마 대통령이 정말로 이야기할 법한 내용이었다면? 전쟁 선포와 같이 중요한 정치적 결정을 포함하고 있었다면? 대통령의 연설임을 믿을 수밖에 없을 만큼 자연스러운 오바마의 얼굴을 보며, 사람들은 딥페이크가 초래할 수 있는 정보적 혼란을 새삼 실감할 수밖에 없었다.

그 이유는 기술 등장 초기, 딥페이크가 주로 음란 영상물에 사용됐기 때문이다. 2017년 말 ‘deepfakes’라는 닉네임을 쓰는 이용자가 미국의 커뮤니티 사이트인 ‘레딧(Reddit)’에 올린 포르노 영상물들이 악명의 기폭제가 됐다. 평소에도 외설적이거나 혐오스러운 이미지와 동영상이 심심치 않게 게시되던 레딧이었지만, ‘deepfakes’가 올린 영상은 사람들의 엄청난 관심을 끌었다. 그 이유는 음란 영상물 속 주인공이 누구나 알 만한 스타들이었기 때문이다. 영상이 워낙 자연스러워 많은 이들은 해당 영상이 사고로 유출된 것은 아닌지 의심했지만 ‘deepfakes’는 이 영상들이 딥러닝 알고리즘을 활용해 포르노 배우의 얼굴을 슈퍼스타의 얼굴로 바꾼 것이라 설명했다. 이때부터 딥페이크는 딥러닝 알고리즘을 활용하여 얼굴이나 신체 부위를 조작, 합성하는 기술을 대표하는 이름이 되었다.

2018년 4월 17일, 언론사 ‘버즈피드(BuzzFeed)’가 유튜브에 동영상 하나를 게재하면서 딥페이크의 악명은 더욱 높아졌다.[2] 영상에서는 버락 오바마(Barack Obama) 미국 전 대통령이 “트럼프 대통령은 완전 머저리”라며 막말을 하고, 극우 인종주의자를 찬양하는 등 믿을 수 없는 말들을 내뱉고 있었다. ‘이 연설이 진짜인가?’라는 의심이 들 때쯤 화면이 둘로 갈라지며 진실이 밝혀진다. 해당 영상은 딥페이크 기술을 활용해 영화감독인 조던 필(Jordan Peele)이 오바마를 성대모사하는 영상에 오바마의 얼굴을 합성한 것이었다. 만약 영상 속 메시지가 오바마 대통령이 정말로 이야기할 법한 내용이었다면? 전쟁 선포와 같이 중요한 정치적 결정을 포함하고 있었다면? 대통령의 연설임을 믿을 수밖에 없을 만큼 자연스러운 오바마의 얼굴을 보며, 사람들은 딥페이크가 초래할 수 있는 정보적 혼란을 새삼 실감할 수밖에 없었다.

일련의 사례들로 대표된 딥페이크는 불법 음란 영상물이나 허위·조작 정보의 주범인 ‘나쁜 기술’이 되곤 한다. 2019년 ‘MIT 테크놀로지 리뷰(MIT Technology Review)’는 인공지능의 위험 요소 여섯 가지 중 하나로 딥페이크 기술의 발전을 꼽았고[3], 미국 국방부는 딥페이크를 방지 기술 개발이 필요한 ‘안보 위협’으로 간주한 바 있다. 유럽의 언론사들은 딥페이크가 초래하는 허위정보(disinformation)를 예방하기 위해 딥페이크 검증 도구를 개발하는 ‘인비드(InVID) 프로젝트’[4]를 진행했고, 딥페이크와 관련해 더욱 강력한 규제 법안을 제정해야 한다는 목소리도 커지고 있다. 어떤 영상을 보든 ‘이 얼굴이 진짜인가?’를 물어야만 하는 상황은 우리에게 곧 ‘진실의 종말(end of truth)’이 닥칠 것이라는 비관적 전망[5]으로 이어지기에 충분하다.

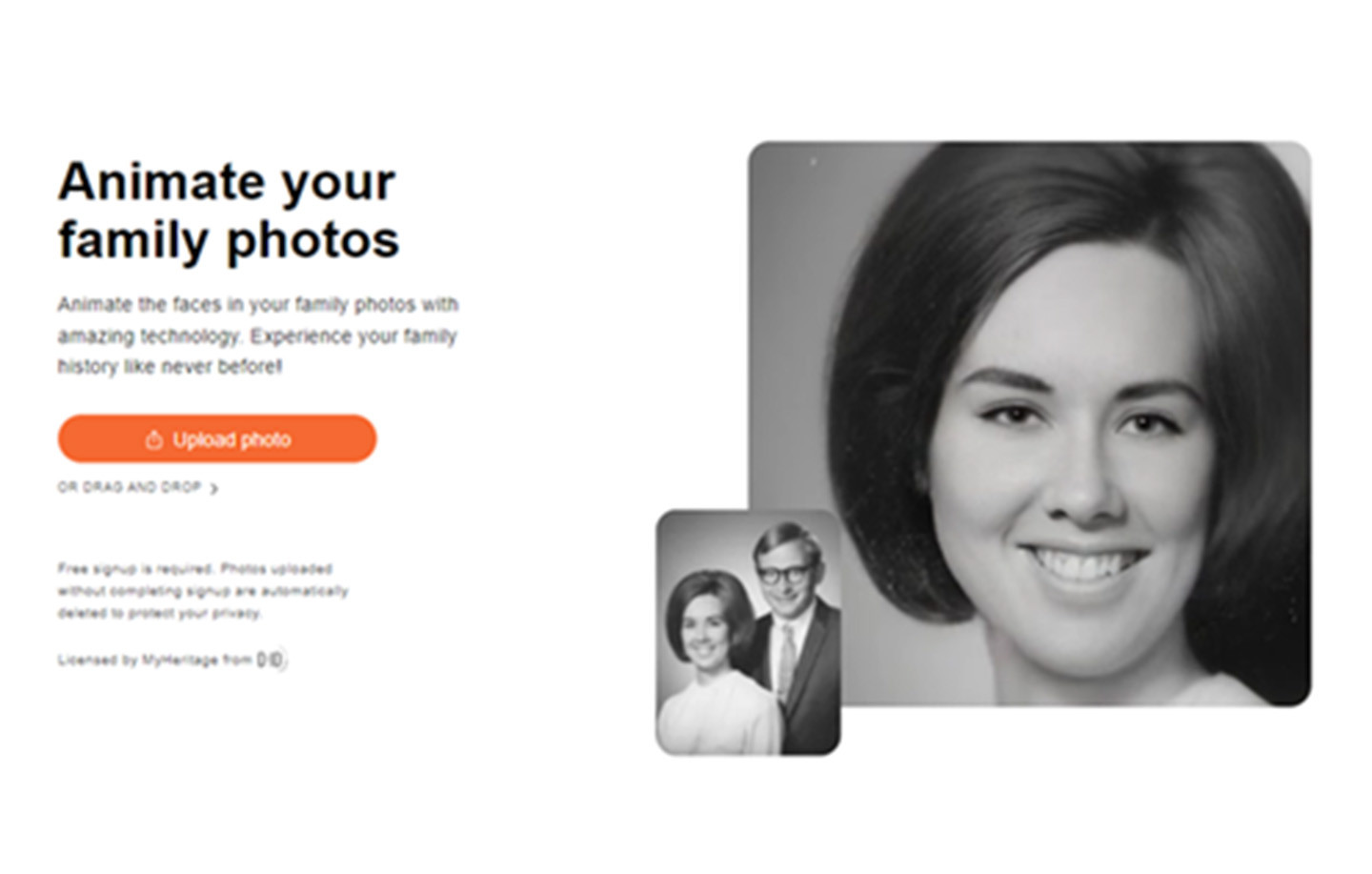

주목할 점은 최근 딥페이크를 창의적으로 활용하는 사례가 등장하고 있다는 점이다. 2020년에 우리는 세상을 떠난 가수 터틀맨이 최신곡을 부르며 움직이는 영상을 확인한 바 있고,[6] 독일의 온라인 족보 사이트 ‘마이헤리티지(MyHeritage)’는 딥페이크 기술을 활용해 세상을 떠난 가족의 사진을 영상으로 변환해주는 ‘딥 노스탤지어(Deep Nostalgia)’ 서비스를 제공하는 중이다.[7] 최근 다수 등장하는 ‘가상 인플루언서(virtual influencer)’들의 얼굴을 합성하는 데도 딥페이크 기술은 널리 활용되며, 의료계에서는 딥페이크로 의학 영상 이미지를 분석해 질병 징후와 이상 신호를 찾아내는 방안을 적극적으로 연구하고 있다.

주목할 점은 최근 딥페이크를 창의적으로 활용하는 사례가 등장하고 있다는 점이다. 2020년에 우리는 세상을 떠난 가수 터틀맨이 최신곡을 부르며 움직이는 영상을 확인한 바 있고,[6] 독일의 온라인 족보 사이트 ‘마이헤리티지(MyHeritage)’는 딥페이크 기술을 활용해 세상을 떠난 가족의 사진을 영상으로 변환해주는 ‘딥 노스탤지어(Deep Nostalgia)’ 서비스를 제공하는 중이다.[7] 최근 다수 등장하는 ‘가상 인플루언서(virtual influencer)’들의 얼굴을 합성하는 데도 딥페이크 기술은 널리 활용되며, 의료계에서는 딥페이크로 의학 영상 이미지를 분석해 질병 징후와 이상 신호를 찾아내는 방안을 적극적으로 연구하고 있다.

이처럼 전과 다른 긍정적 사례들이 등장하면 딥페이크에 대해 우려했던 점들이 자연스레 해결될 수 있을까? 좋은 의도로 좋게 활용되면 나쁜 기술이던 딥페이크가 좋은 기술로 변모하는 것일까? 이러한 물음은 사실 매우 어리석다. 좋고 나쁜 것은 기술의 활용 방식일 뿐, 기술 자체는 언제나 중립적이기 때문이다. 딥러닝을 활용한 이미지 합성·조작 기술이 ‘거짓(fake)’의 이름을 가지게 된 것은 레딧에 ‘deepfakes’라는 이용자가 올린 나쁜 영상물들이 큰 관심을 받았기 때문이지 기술 자체가 지닌 허위성 때문이 아니다. 기술 자체는 가치를 내포하지 않기에 딥페이크의 ‘좋고 나쁨’을 이야기하는 것은 크게 중요한 일이 아니다. 중요한 것은 우리 사회가 이 기술의 의미를 얼마나 잘 이해하고, 활용하며, 대응할 수 있는가의 문제다. 이를 파악하기 위해서는 딥페이크 기술의 원리와 활용 사례를 다각도로 살펴보는 일이 필요할 것이다.

딥페이크는 어떤 원리로 이미지를 합성하고 조작하며, 어떤 영역에서 주로 활용되고 있을까? 활용 사례들이 이야기해주는 것은 무엇이며, 이를 통해 우리가 이해할 수 있는 딥페이크 기술의 의미는 무엇일까? 딥페이크 ‘규제론’과 ‘활용론’이 대립하는 가운데, 《딥페이크의 얼굴》 은 위의 질문들을 통해 딥페이크가 조금 더 사회적이고 문화적인 성찰이 필요한 기술임을 드러내고자 한다. 이를 위해 딥페이크가 과거의 이미지 합성·조작 기술과 무엇이 다른지 먼저 살펴보고, 딥페이크가 활용된 다양한 사례를 통해 이 기술의 의미와 가치, 한계를 검토해 본다. 아울러 딥페이크 기술의 악용을 최소화하기 위한 과제를 탐색할 것이다. 이러한 논의 이후에야 우리는 딥페이크의 얼굴이 진짜인지를 넘어, 더욱 깊은 질문을 던질 수 있을 것이다.

딥페이크는 어떤 원리로 이미지를 합성하고 조작하며, 어떤 영역에서 주로 활용되고 있을까? 활용 사례들이 이야기해주는 것은 무엇이며, 이를 통해 우리가 이해할 수 있는 딥페이크 기술의 의미는 무엇일까? 딥페이크 ‘규제론’과 ‘활용론’이 대립하는 가운데, 《딥페이크의 얼굴》 은 위의 질문들을 통해 딥페이크가 조금 더 사회적이고 문화적인 성찰이 필요한 기술임을 드러내고자 한다. 이를 위해 딥페이크가 과거의 이미지 합성·조작 기술과 무엇이 다른지 먼저 살펴보고, 딥페이크가 활용된 다양한 사례를 통해 이 기술의 의미와 가치, 한계를 검토해 본다. 아울러 딥페이크 기술의 악용을 최소화하기 위한 과제를 탐색할 것이다. 이러한 논의 이후에야 우리는 딥페이크의 얼굴이 진짜인지를 넘어, 더욱 깊은 질문을 던질 수 있을 것이다.

[1]

이승환, 〈빅데이터로 본 딥페이크(Deepfake): 가짜와의 전쟁〉, 소프트웨어정책연구소 Issue Report, 2020.

[2]

BuzzFeedVideo, 〈You Won’t Believe What Obama Says In This Video!〉, 2018. 4. 18.

[3]

Will Knight and Karen Hao. 〈Never mind killer robots—here are six real AI dangers to watch out for in 2019〉. 《MIT technology review》. 2019. 1. 7.

[4]

https://www.invid-project.eu/

[5]

Michael Horowitz et al., 〈Artificial Intelligence and International Security〉, 2018.

[6]

MnetTV, 〈♬새로운 시작 by 거북이 (터틀맨, 금비, 지이)〉, 2020. 12. 9.

[7]

https://www.myheritage.co.kr/deep-nostalgia